训练还是不训练:支持与反对应用层公司开展后训练的理由

朋友们,你们好,

几周前,我写过一篇文章,谈到 AI 应用公司正越来越多地走向 full-stack,向下整合至模型层,或向上延伸至服务层。此后,围绕进入模型层的利弊以及何时才是合适时机,出现了大量讨论,这也正是今天这篇文章的重点。

需要明确的是,这里的讨论针对的是应用层公司,而非前沿实验室。这类公司中,几乎没有多少是在从零开始进行预训练。相反,大多数公司是在强大的开放权重基础模型之上进行后训练和强化学习。

在这篇文章中,我将讨论:

-

训练光谱

-

支持这样做的理由

-

反对这样做的理由

-

在适当的时候,以及正在降低门槛的新基础设施

一、训练光谱

“训练自己的模型”这一说法,常被用来指代投入程度截然不同的各种做法。

在最极端的一端,是提示工程、RAG 和编排工程,这些都不属于任何形式的训练。再往上一步,是对小模型进行微调。再往上,是将强大的开放权重基础模型作为系统中的主模型,并在其之上进行监督微调或强化学习。更进一步,则是在开放权重模型基础上继续进行预训练。最远的一端,则是从零开始预训练。

对于应用公司而言,基本上没有谁处在最远端,但从那里往右看,你会看到不同位置上的一些例子。Cursor 的 Composer 2 构建于 Kimi K2.5 之上。Intercom 的 Fin Apex 1.0 建立在一个未披露的开放权重基础模型之上。Cognition 的 SWE-1.5 用他们自己的话说,是“在领先的开源基础模型之上,使用我们定制的 Cascade 智能体 harness,在真实任务环境中进行端到端强化学习”。

正如 Intercom 的 CEO 所说,预训练已经“在某种程度上成为一种大宗商品”,真正的看点在后训练。因此,本文大部分内容都将围绕后训练而非预训练展开。

二、支持训练的理由

在我看来,投资后训练有三个真正的理由。

1. 单位经济效益与延迟

一旦达到规模,API 调用成本就会迅速累积。一个运行成本更低、返回时间仅 200 毫秒的小型专用模型,可能胜过一次耗时 2 秒、成本高出 10 倍的前沿模型调用。

据报道,Intercom 的 Fin Apex 1.0 运行成本约为前沿模型的五分之一,响应速度比下一个最快的竞争对手快 0.6 秒,且解决客户问题的比率更高。对于像 Intercom 这样每周处理约 200 万次对话的公司而言,这种延迟和单位经济效益上的差距具有重要意义。

与此相关的还有一个关乎命运的论点:如果你的单位经济效益依赖于单一前沿 API,你就会暴露在价格调整、速率限制以及服务提供商亲自进入你所在类别的风险之下。没有谁比 Cursor 对此感受更深——尽管其取得了巨大成功、使用量也十分可观,但据报道其毛利率却为 -21%,而且在 Anthropic 的限制条件使其 200 美元最高档套餐可支持价值数千美元的等效算力时,Cursor 也发现自己很难与 Claude Code 竞争。

2. 通过专有数据实现差异化

如果所有人调用的都是同一个前沿 API,你的优势在哪里?越来越多的情况下,答案只能来自你所积累的数据痕迹。

Cursor 能看到哪些补全结果被接受、哪些被拒绝。Intercom 拥有数十亿次客户服务互动数据。OpenEvidence 掌握着美国 40%医生的查询与引用数据,并通过合作伙伴关系获取经同行评审的医学文献数据,训练出了一款领域专用模型。这些都是专有训练数据,而将其价值最大化的最佳方式,就是进行训练或后训练。

从某种意义上说,应用层真正的价值在于,它们能够就客户群体的真实使用场景获取最优质的遥测数据,这远非任何现成评测所能衡量。

通过利用这些数据对模型进行后训练,他们实际上能够提升用户体验到的性能,同时还能获得上述延迟和单位经济效益方面的优势。

例如,Cursor 的 Composer 2 部分是基于其内部评测集 Cursor-bench 进行优化的,该评测集是他们依据真实运行轨迹创建的。他们认为,与公开可用的基准测试相比,这一基准更能代表开发者在其平台内实际开展的工作。

3. 为前沿实验室未优先关注的环节打造专用模型

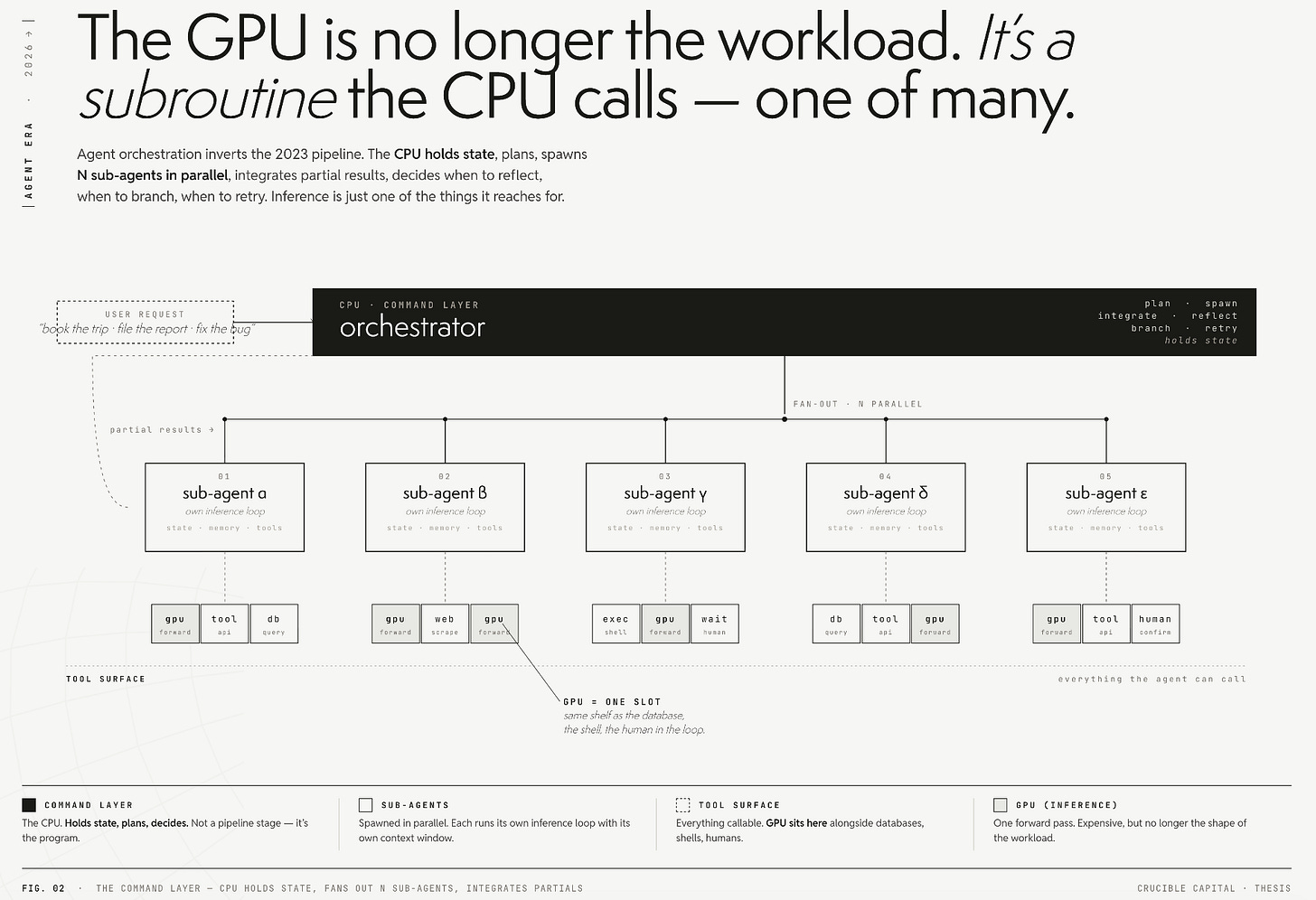

大多数应用公司并不是只训练一个大型定制模型来取代前沿模型。它们运行的是由多个小型专用模型组成的系统,每个模型都针对流程中前沿实验室未加以优化的某一环节进行微调。

Decagon 对此有过阐述:针对查询重写、路由和意图分类,使用更小型的微调模型,只有在确有必要时才调用前沿模型。Sierra 在一个仍以 OpenAI、Anthropic 为核心模型的模型星座体系内,训练了定制搜索模型(Linnaeus 和 Darwin)。Cognition 则拥有用于上下文的 SWE-grep、用于漏洞检测的 SWE-check,以及作为主代理的 SWE-1.5。

大部分价值都存在于流程中那些看似乏味的环节(语音活动检测、查询重构、检索排序、工具选择)中。这些环节都不需要前沿级推理模型。它们无一例外都会受益于更快、更便宜,并且针对你的特定数据进行调优。

对许多公司来说,这是切入微调和后训练的一种极佳方式:在前沿模型无法充分满足你需求的地方自行训练,而在其能够胜任的地方继续使用前沿模型。

III. 反对理由

最需要谨慎的原因是: 你经过后训练的模型,可能撑不过实验室下一次基础模型的发布 。如今,这些实验室推出新模型的速度比以往任何时候都更快,因为它们自己也在用自家模型去构建下一代模型。

Anthropic 的 Dario Amodei 表示,如今新 Claude 模型中有 70%至 90%的代码已由 Claude 自行编写。OpenAI 在其 GPT-5.3-Codex 发布时说得更为直白(如今已落后 0.2 代了 :)):

“GPT-5.3-Codex 是我们首个在自身构建过程中发挥关键作用的模型。Codex 团队使用其早期版本来调试自身训练、管理自身部署,并诊断测试结果。”

这意味着:过去往往需要数月才会发布的新模型,如今已缩短至仅相隔数周。OpenAI 在短短数月内推出了 GPT-5、5.2、5.3、5.4 和 5.5。

对于一家应用公司来说,这是最大的风险。2022 年至 2024 年期间,许多微调带来的优势在 GPT-4 和 Claude 3.5 推出后都消失了,而如今这一周期变得更快。

这就是为什么总体而言,与其针对前沿任务中的核心推理模型进行训练,为在模型系统中协同工作的专用模型进行后训练或微调要安全得多,因为即便基础模型不断改进,这类做法在成本和时延上的优势也更有可能得以保留。

还有其他成本需要考虑,尤其是后训练人才稀缺且昂贵。用于模型后训练的人才和资本所产生的机会成本,本可以更好地投入或运用于产品和公司的其他方面。

四、何时应该这样做

一个有用的衡量标准是:当你拥有足够多的专有轨迹数据,足以让一个小型专业化模型在你流程中的某个特定环节上显著优于前沿模型时,就该进行训练。

我还应该指出,如今启动这件事的门槛也比一年前更低了,因为一个新的基础设施层已经出现,以不同形式支持后训练。

-

Thinking Machine Labs 推出的 Tinker 是一种托管式后训练 API。他们负责分布式训练和 LoRA 基础设施,而你只需提供数据、算法和环境。正如 Andrej Karpathy 指出 :它让用户保留了约 90% 的算法控制权,同时消除了约 90% 的基础设施痛点。

-

Prime Intellect 的 Lab 与之类似,提供托管式 RL 训练,以及一个开放的 Environments Hub,内有数百个由社区构建的 RL 环境。

-

Applied Compute 由前 OpenAI 研究人员创立,提供更偏向白手套式服务的方案,利用 RL 环境基于企业专有数据进行后训练,也是众多提供某种形式“RL 即服务”的公司之一。

-

Mercor、Surge AI、Fleet 等供应商出售由专家定制编写的强化学习环境

-

最后,中国各实验室及其可与前沿闭源模型竞争的开源基础模型,正成为许多人的起点。

我确实认为,基础设施的改善意味着,如今即便是 10 到 20 人的小团队,如果愿意,也可以进行后训练。但我喜欢的一句信条,对大多数应用层公司来说至今仍然适用:“在实现 PMF 之前,不要上 GPU。” 如果你还没有成熟的产品,或者还没有足够的轨迹数据,那么为了这个产品去训练模型还为时过早。

一旦公司正处于快速扩张阶段并已收集到足够的轨迹数据,或者至少已经实现 PMF,却感觉前沿模型在其产品的某些专业化环节上仍无法满足需求,并认为基础模型可以弥补这些不足,那么后训练就应该成为讨论的一部分。

结语

向模型层向下整合的公司(Cursor、Intercom、Sierra、Decagon、Cognition、OpenEvidence)并不是因为喜欢训练模型才这么做。他们之所以这样做,是因为在其当前规模和所掌握的轨迹数据条件下,经济性与差异化的逻辑终于成立了。而且,他们几乎无一例外都是通过后训练来实现,而不是从零开始进行预训练。

对于大多数仍处于生命周期早期的应用公司而言,到2026年,坦诚的答案是:还没到时候,但应开始为此做准备。现在就构建数据收集能力(追踪、评估)。先从流程中一个不起眼环节里的小型专用模型入手,而不是试图在主要推理调用上取代前沿模型。

真正具有持久价值的训练投资,是你所积累的数据和环境;随着底层基础模型持续进步,这些积累让你能够不断产出更优秀的模型。别忘了,这些基础模型的进步速度比以往任何时候都更快。

如果你正在开发一款 AI 应用,或正在思考这种权衡,欢迎通过 tanay at wing.vc 与我联系。