为什么可观测性正成为智能体系统的真实层

AI 正在从聊天界面迈向自主软件系统,这类系统能够进行规划、执行操作、使用工具,并在持续时间更长的工作流中协调工作。随着这一转变加速,围绕智能体编排的新基础设施层正在形成:即管理规划、执行、记忆、交接、治理和控制的系统。

在这一技术栈中,有一层既至关重要又建设不足:可观测性。

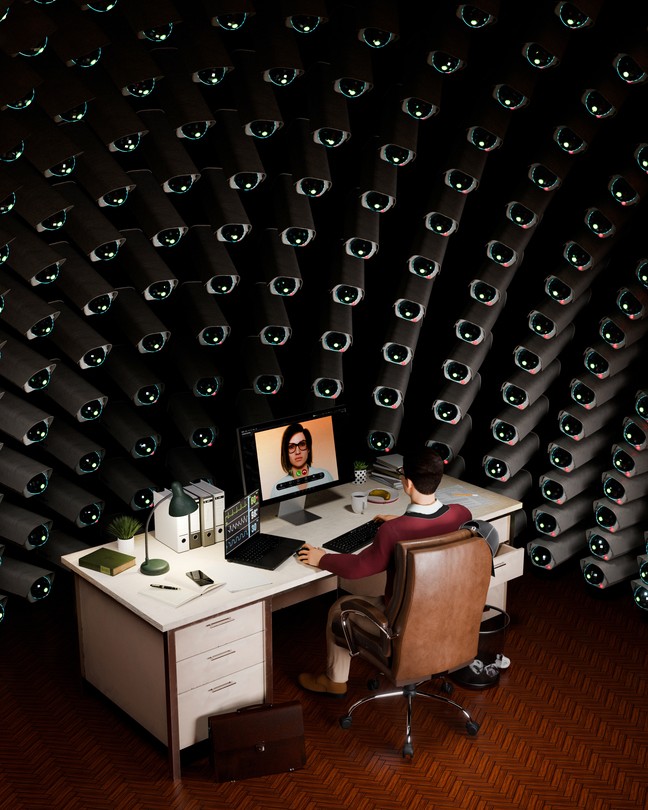

在多智能体系统中,可观测性不仅仅是调试功能。它会成为对实际发生情况的记录:任务是如何被拆解的、选择了哪个智能体、它看到了哪些上下文、调用了哪些工具、读取或写入了哪些记忆、交接发生在何处、防护机制是否介入、何时触发了人工审批,以及延迟和成本在何处累积。

在实践中,这会成为系统实际行为方式的唯一可靠记录,而不只是它本应如何运行,从而实际上充当了智能体执行的“真相层”。

这与第一代 LLM 可观测性所面对的问题不同。如今的许多工具都是围绕一种更简单的基本模式构建的:一个应用、一个提示词、一个输出。这适用于提示词检查和基础日志记录,但无法解决更困难的问题——在非确定性执行图中重建因果关系。

这就是为什么多智能体系统看起来更不像聊天产品,而更像分布式系统。但在某些方面,它们比传统分布式软件更难观测,因为许多重要事件是非结构化的,规划器行为具有概率性,而破坏性最大的故障往往是语义层面的,而非二元式的。

而这类软性故障,正是这一类别变得最为重要的地方。服务崩溃或 API 调用失败很容易检测。这些正是传统可观测性原本就被设计用来捕捉的那类故障。

更难察觉的是:智能体选错了工具,却仍返回看似合理的结果;检索步骤调出了过时的记忆;交接过程中丢失了关键上下文;或者某个子智能体做出了薄弱推断,而下游智能体却将其当作事实。这些并非边缘案例,而是多智能体系统中非确定性、状态衰减、错误放大、通信开销和冲突解决所带来的自然结果。

在生产环境中,这类故障很少触发警报。它们会悄然侵蚀性能,随着时间推移不断累积,并让那些表面上看似正常运行的系统滋生出虚假的信心。

这正是编排技术栈不断演进的背景。规划与路由层、智能体注册表、共享状态、治理、协议、工作流引擎以及框架生态系统都在快速发展。模型提供商也在沿着这条技术栈向上延伸。

OpenAI 的 Agents SDK 围绕工具使用、交接和追踪构建,并将智能体应用描述为能够保留“发生过事情的完整追踪”的系统。Anthropic 也正朝着类似方向发展,推出了 Claude Managed Agents——一项面向长周期智能体任务的托管服务,即便底层支撑框架不断演进,仍围绕稳定接口构建。

这印证了这一层的重要性,但并不意味着创业机会就此消失。大多数企业不会运行一个干净、单一提供商的技术栈。它们会采用某种组合:提供商托管的智能体、开放框架、内部工作流、遗留编排系统以及特定领域软件。这使得中立性不仅有价值,而且是必要条件。持久的机会不仅在于暴露某一个运行时内部的遥测数据,而在于成为贯穿所有这些系统的真相层。

这一类别中最强的公司,最终可能看起来根本不像一家提示词分析供应商。

相反,它看起来可能更像是那家为智能体系统定义规范遥测模型的公司。实际上,这意味着要定义如何衡量执行过程:针对智能体跨度、交接、记忆事件、工具调用、政策检查、审批关卡、重放以及分支级成本归因的“评分”标准。类似于传统系统中的可观测性最终围绕共享惯例趋于统一,定义这些标准的系统将拥有异常强大的市场塑造能力。

我们的观点是,可观测性是当今智能体编排领域最锋利的切入点之一。随着智能体系统从演示走向生产环境,挑战已不再只是如何运行它们,而是如何理解它们。没有清晰的真相层,团队就无法可靠地管理成本、建立信任,或维持对那些不再以确定性方式运行的系统的控制。